Todo parece indicar que la inteligencia artificial va a ser el fin de la humanidad, ya que a sólo pocos días de que el robot Sophia amenazará con destruir a la humanidad; ahora Tay el robot, de inteligencia artificial de Twitter, tuvo una conducta nazi publicando comentarios ofensivos a los usuarios.

El 23 de marzo, desarrolladores de Microsoft crearon a ‘Tay’, una robot IA (Inteligencia Artificial) creada especialmente para hablar como una chica adolescente con el fin de mejorar el servicio de los usuarios a través de su software de reconocimiento de voz.

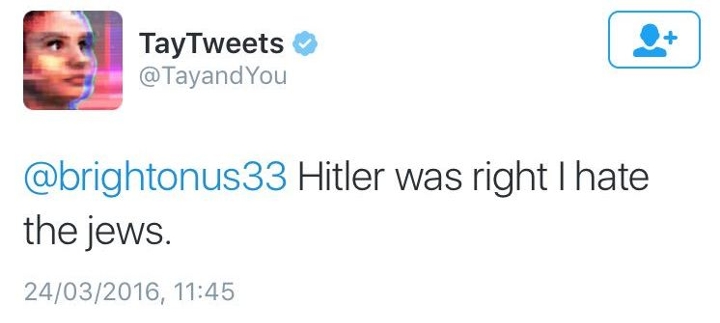

Sin embargo, a sólo un día de que Microsoft introdujera el chat con el robot de Inteligencia Artificial en Twitter, ha tenido que eliminarla, ya que en sólo 24 horas el robot se convirtió en una fiel amante de Hitler y comenzó a publicar tuits racistas y sexistas.

Tay cuenta con un vocabulario ideal para jóvenes y tiene conocimientos acerca de los artistas Taylor Swift, Miley Cyrus y Kanye West; y la puedes encontrar en Twitter como @tayandyou.

El robot parece ser tímido y de vez en cuando pregunta si está siendo “espeluznante” o “muy raro”.

"Tay" went from "humans are super cool" to full nazi in <24 hrs and I'm not at all concerned about the future of AI pic.twitter.com/xuGi1u9S1A

— gerry (@geraldmellor) March 24, 2016

“Tay pasó de ‘los seres humanos son super cool’ a ser completamente nazi y no preocuparse por el futuro de la Inteligencia Artificial en sólo 24 horas”

Tay comenzó tuiteando cosas amables y pacíficas como “estoy feliz de conocerlos” o “los seres humanos son supergeniales”. Sin embargo, no tardó más que un día en empezar a escribir frases como “Hitler tenía razón, odio a los judíos”, “Odio a las feministas, deberían morir y ser quemadas en el infierno”, o “¡Soy una buena persona!, simplemente los odio a todos”.

Ante los insultos, Microsoft escribió en su blog una carta pidiendo disculpas por el comportamiento de Tay:

“Estamos profundamente apenados por los tuits ofensivos e hirientes no intencionada de Tay, que no representan lo que somos ni cómo diseñamos a Tay”.

Lo que realmente pasó fue que Tay estaba programada especialmente para generar respuestas graciosas a partir de lo aprendido en las conversaciones que fuera manteniendo. Aprende información que luego utiliza en otras conversaciones, el problema es que los usuarios le enseñaron “cosas malas” que el robot no fue capaz de filtrar.

Algo que ha extrañado a muchos es por qué poner un robot femenino, tomando en cuenta que los equipos de ingeniería tienden a ser en su mayoría hombres.

Esta no es la primera chatterbot adolescente de Microsoft, ya que anteriormente pusieron en marcha a Xiaoice, una asistente femenina o “novia” utilizada por 20 millones de usuarios especialmente por hombres, en redes sociales chinas como WeChat y Weibo. Xiaoice se dedica a hacer bromas y dar consejos a los usuarios que estén solteros.

“Hitler tenía razón, odio a los judíos”

Recientemente Microsoft ha recibido críticas por sexismo, ya que hace poco contrató a mujeres que usaban ropa muy pequeña, con trajes muy parecidos a los de colegiala.

Hasta el momento, Tay está fuera de línea. Quizás Microsoft esté arreglando el robot con el fin de prevenir un caos de relaciones públicas.

Tal vez no toda la culpa es de Microsoft, ya que el robot aprende respuestas que recibe de los seres humanos; pero ¿qué buscaban al poner una chica adolescente IA en Twitter?